Se vuoi imparare come utilizzare DeepSeek V3 Coder in Windows 11 , questo post ti guiderà. DeepSeek-V3 Coder è una versione specializzata del modello DeepSeek-V3. Sfrutta l'elaborazione del linguaggio naturale e tecniche avanzate di apprendimento automatico per comprendere e generare codice, fornire assistenza alla programmazione e aiutare gli utenti nelle attività di sviluppo software.

Come utilizzare DeepSeek V3 Coder in Windows 11?

DeepSeek V3 Coder è per coloro che desiderano migliorare le proprie capacità di codifica o semplificare il processo di sviluppo del software. Se lo desidera utilizzare DeepSeek V3 Coder in Windows 11 , puoi accedervi tramite il file piattaforma dimostrativa online , API servizio o scarica i pesi del modello per distribuzione locale . Vediamo come.

1] Accedi a DeepSeek-V3 Coder tramite browser Web

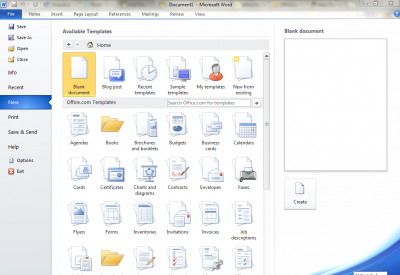

Avvia il tuo browser preferito, digita www.deepseekv3.com nella barra degli URL e premi Invio. Verrai reindirizzato al sito Web ufficiale di DeepSeek. Fare clic su ' Prova DeepSeek V3 pulsante 'nell'angolo in alto a destra.

Vedrai l'interfaccia della chat di DeepSeek. Digita la tua query nella casella di input della chat e premi Entra . DeepSeek V3 genererà rapidamente una risposta per te.

Windows 7 interrompe la notifica di Windows 10

Registrati con DeepSeek per ottenere l'accesso a funzionalità premium o opzioni avanzate, come il salvataggio della cronologia chat o la personalizzazione delle preferenze.

Tipo chat.deepseek.com nella barra degli URL del tuo browser e premi Entra . Successivamente, registrati per un account DeepSeek. Dopo l'accesso, vedrai un'interfaccia di chat basata sull'ultimo modello DeepSeek-V3. È possibile utilizzare l'interfaccia per inserire query di codifica, generare codice o eseguire il debug di programmi.

2] Accedi a DeepSeek-V3 Coder tramite API

Per accedere al modello DeepSeek-V3 tramite API su Windows 11, attenersi alla seguente procedura:

Registra un account sulla piattaforma DeepSeek per ricevere la tua chiave API.

Scarica e installa Python da python.org , se non già installato. Durante l'installazione, assicurati di selezionare la casella Aggiungi python.exe al PERCORSO (se Python viene aggiunto al PERCORSO, puoi semplicemente digitare python o pip in qualsiasi finestra di terminale e il sistema saprà dove trovare l'interprete Python o il gestore pacchetti. Senza aggiungendo Python al PERCORSO, dovresti navigare nella directory specifica in cui è installato Python, ogni volta che desideri eseguire un comando Python).

Successivamente, installa l'SDK appropriato.

L'API DeepSeek utilizza un formato API compatibile con OpenAI, quindi puoi accedere all'API DeepSeek utilizzando OpenAI SDK o qualsiasi software compatibile con API OpenAI. Per installare OpenAI SDK, apri il prompt dei comandi ed esegui il seguente comando:

pip install openai

Una volta configurato l'ambiente di sviluppo, configura l'accesso API impostando l'URL di base su:

'https://api.deepseek.com'

Quindi accedi al modello DeepSeek V3 effettuando chiamate API. Ecco un esempio Python per interagire con il modello DeepSeek V3:

come disinstallare il blocco note

from openai import OpenAI

client = OpenAI(api_key="<DeepSeek API Key>", base_url="https://api.deepseek.com")

response = client.chat.completions.create(

model="deepseek-chat",

messages=[

{"role": "system", "content": "You are a helpful assistant"},

{"role": "user", "content": "Hello"},

],

stream=False

)

print(response.choices[0].message.content)Nota:

- IL nome del modello

deepseek-chatrichiamerà DeepSeek V3. - Abilita lo streaming impostando

'stream=true'. Lo streaming è ideale per scenari di risposta in tempo reale.

3] Accedi a DeepSeek-V3 Coder tramite la distribuzione locale

La distribuzione locale di DeepSeek V3 implica il download dei pesi del modello e la configurazione dell'ambiente necessario. Tuttavia, non esiste un documento ufficiale di DeepSeek V3 appositamente studiato per la distribuzione del modello localmente su Windows 11. guide di distribuzione disponibili concentrarsi principalmente su Linux ambienti, in particolare Ubuntu 20.04 o successiva .

Per la distribuzione locale di DeepSeek-V3 Coder su Windows 11, puoi creare un ambiente simile a Linux all'interno del tuo sistema Windows.

Prima di procedere, assicurati che il tuo sistema soddisfi questi requisiti hardware e software minimi:

- GPU: GPU NVIDIA con supporto CUDA (ad esempio, serie RTX 30xx o successiva).

- Pitone: Versione 3.8 o successiva.

- Memoria: Almeno 16 GB di RAM (consigliati 32 GB).

- CUDA e cuDNN: Installa le versioni compatibili con le dipendenze di DeepSeek V3.

Ora segui questi passaggi:

Installa il sottosistema Windows per Linux 2 sul tuo PC Windows 11 .

Clonare il repository DeepSeek V3:

git clone https://github.com/deepseek-ai/DeepSeek-V3.git

Passare alla directory di inferenza e installare le dipendenze elencate in requirements.txt:

cd DeepSeek-V3/inference pip install -r requirements.txt

Prossimo, scarica i pesi del modello da Abbracciare il viso e inserirli nella cartella /path/to/DeepSeek-V3.

Successivamente, converti i pesi del modello in un formato specifico:

python convert.py --hf-ckpt-path /path/to/DeepSeek-V3 --save-path /path/to/DeepSeek-V3-Demo --n-experts 256 --model-parallel 16

Ora puoi chattare con DeepSeek-V3 o eseguire l'inferenza batch su un determinato file.

Questo è tutto! Spero che lo troverai utile.

Windows 10 pin vs password

Leggere: I migliori assistenti per la generazione di codici AI per VS Code .

DeepSeek è gratuito?

DeepSeek fornisce accesso gratuito a determinati modelli, consentendo agli utenti di sperimentarne le capacità senza costi immediati. Altri modelli funzionano a pagamento, con costi determinati dall'utilizzo. L'ultimo modello, DeepSeek-V3, ha una struttura dei prezzi di 0,14 dollari per milione di token di input e 0,28 dollari per milione di token di output (è previsto uno sconto continuo sui prezzi di DeepSeek-V3 fino all'8 febbraio 2025).

Di quale GPU hai bisogno per DeepSeek Coder V2?

La distribuzione di DeepSeek-Coder-V2 richiede notevoli risorse GPU a causa delle grandi dimensioni e della complessità del modello. Per l'inferenza in formato BF16 (bfloat16), il modello necessita di 8 GPU, ciascuna dotata di 80 GB di memoria.

Leggi dopo: I migliori strumenti AI da Screenshot a Codice .